文献深度解读:迎接大原子模型时代——基于线图序列的图神经网络 DPA3

文献信息:

标题: A Graph Neural Network for the Era of Large Atomistic Models 作者: Duo Zhang, Anyang Peng, Chun Cai, …, Linfeng Zhang, Han Wang (AI for Science Institute, DP Technology, 北京大学等) 预印本: arXiv:2506.01686v2 核心贡献: 提出了 DPA3 架构,基于线图序列(Line Graph Series, LiGS)设计。该模型严格遵循 Scaling Law(缩放定律),通过引入“数据集编码(Dataset Encoding)”解决了多精度数据集混合训练的难题,在 LAMBench 等多个基准测试中展现出 SOTA 的零样本(Zero-shot)泛化能力。

1. 引言:从“专用力场”到“大原子模型 (LAMs)”

在过去十年中,机器学习原子间势函数(MLIPs)极大地加速了分子动力学模拟。然而,传统的 MLIPs 往往是“专模专用”的——研究一个新系统,就需要重新生成 DFT(密度泛函理论)数据并重新训练模型。

随着数据量的爆发,领域内的目标正在发生转移:能否像 ChatGPT 一样,训练一个“大原子模型(Large Atomistic Models, LAMs)”? 这样一个基础模型应该能够开箱即用地处理各种原子系统,或者只需极少量数据微调即可。

要实现 LAM,面临三大挑战:

- Scaling Law(缩放定律): 模型架构必须能够随着参数量、数据量和算力的增加,稳定地提升泛化能力。

- 数据兼容性: 现有的开源数据集(如 Materials Project, SPICE, OC20)使用了不同的 DFT 泛函(如 PBE, B3LYP, \(\omega\)B97M)。如何把这些“标准不一”的数据放在一起训练?

- 物理约束: 模型必须是平滑的、保守的(能量守恒),并且满足平移、旋转和置换不变性。

DPA3 的诞生,正是为了系统性地解决这三大挑战。

2. 核心架构:线图序列 (Line Graph Series, LiGS)

对于图神经网络(GNN)专家来说,如何高效地捕捉原子的多体相互作用(角度、二面角等)一直是个难题。DPA3 巧妙地引入了数学图论中的线图变换(Line Graph Transform, \(\mathscr{L}\))。

2.1 什么是线图变换?

简单来说,给定一个图 \(G\),它的线图 \(\mathscr{L}(G)\) 是这样构造的:

- 原图 \(G\) 中的每一条边,变成新图 \(\mathscr{L}(G)\) 中的一个节点。

- 如果原图 \(G\) 中的两条边共享同一个顶点,那么在新图 \(\mathscr{L}(G)\) 中,这两个对应的节点之间就连一条边。

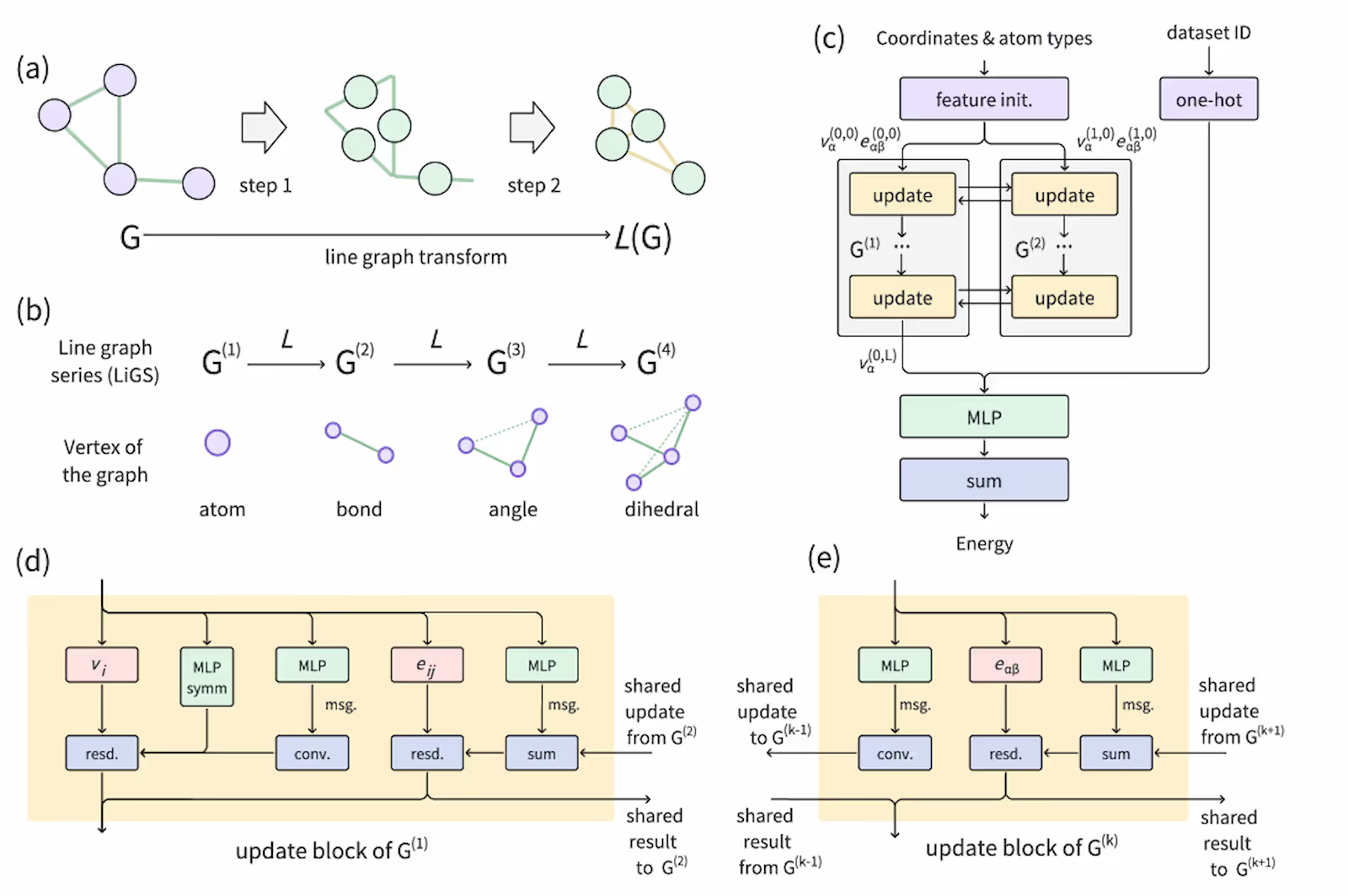

图 (a) 和 (b) 形象地展示了线图序列(LiGS)的生成过程:原子(Atom)构成 \(G^{(1)}\) 的节点;化学键(Bond)构成 \(G^{(2)}\) 的节点;键角(Angle)构成 \(G^{(3)}\) 的节点;二面角(Dihedral)构成 \(G^{(4)}\) 的节点。图 (c)-(e) 展示了特征在不同阶图之间的残差更新机制。

2.2 LiGS 在物理上的绝妙映射

通过不断迭代线图变换,DPA3 构建了一个图序列 \(\{G^{(1)}, G^{(2)}, G^{(3)}, \dots\}\)。这在物理上有着极其直观的对应关系:

- \(G^{(1)}\) 的节点: 代表原子(单体)。

- \(G^{(2)}\) 的节点: 代表原子对/化学键(两体距离)。

- \(G^{(3)}\) 的节点: 代表键角(三体角度)。

- \(G^{(4)}\) 的节点: 代表二面角(四体扭转角)。

在 DPA3 中,高阶图的节点特征更新后,会直接回传给低阶图作为边特征。这种递归的消息传递机制,使得模型无需显式地计算复杂的高阶球谐函数,就能极其高效地捕捉局域的复杂几何结构。

2.3 能量与力的严格物理约束

DPA3 预测系统的总能量 \(E\) 为各原子局部能量 \(E_i\) 之和。为了保证能量守恒(保守场),原子受力 \(F_i\) 和维里张量 \(\Xi_{pq}\) 严格通过能量对坐标的自动微分(反向传播)求得:

$$ F_i = -\nabla_{r_i} E, \quad \Xi_{pq} = -\sum_r \frac{\partial E}{\partial \mathbf{h}_{rp}} \mathbf{h}_{rq} $$3. 解决“数据大杂烩”:数据集编码 (Dataset Encoding)

正如前文所述,不同数据集的 DFT 计算设置(如泛函、基组)不同,导致能量标签存在系统性偏差。

为了在同一个网络中同时训练这些数据,DPA3 引入了数据集编码 \(c(\mathscr{D}_m)\)。原子 \(i\) 的能量贡献 \(E_i\) 被定义为:

$$ E_i = \mathscr{F} \left( v_i^{(1,L)}, c(\mathscr{D}_m) \right) + e_m(Z_i) $$其中:

- \(v_i^{(1,L)}\) 是经过 \(L\) 层图网络更新后的原子 \(i\) 的特征描述符。

- \(c(\mathscr{D}_m)\) 是一个代表特定数据集 \(\mathscr{D}_m\) 的 One-hot 编码向量。

- \(\mathscr{F}\) 是拟合网络(MLP)。

- \(e_m(Z_i)\) 是针对该数据集拟合的单原子能量偏置(用于对齐能量零点)。

专家看点: 相比于为每个数据集单独设立一个 Readout Head(这会导致模型参数量随数据集数量线性增长),DPA3 的做法是将数据集信息作为特征输入到统一的拟合网络中。这种设计解耦了训练数据规模与模型参数规模,使得模型可以轻松扩展到包含数十个不同数据集的 OpenLAM 集合中,而不会导致参数爆炸。

4. 见证奇迹:大原子模型的 Scaling Law

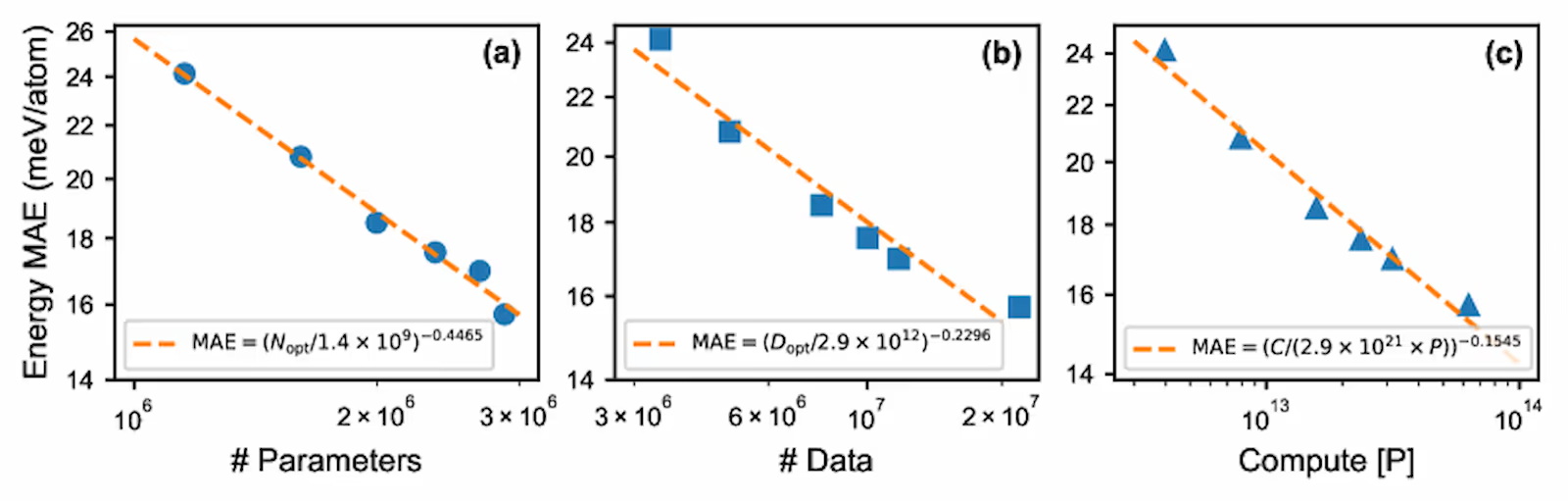

大语言模型(如 GPT-4)的成功离不开 Scaling Law。DPA3 团队在原子模型上也严格验证了这一点。

他们定义了泛化误差(MAE)与模型参数量 \(M\)、训练步数 \(S\)(代表数据量)和计算预算 \(C\) 之间的经验幂律关系:

$$ \text{MAE}(M,S,C) = \alpha_m M^{\beta_m} + \alpha_s S^{\beta_s} + \alpha_c C^{\beta_c} $$

图片说明: 图表展示了在 MPtrj 数据集上,随着模型层数(L3 到 L24)和训练步数的增加,测试集上的能量 MAE 呈现出极其平滑和规律的下降趋势。拟合的 \(R^2\) 高达 0.981,完美印证了 Scaling Law。

这一发现意义重大:它证明了 DPA3 架构没有遇到 GNN 常见的“过平滑(Oversmoothing)”瓶颈。只要给它更多的算力和数据,加深网络层数,它的性能就能持续、可预测地提升。

5. 惊艳的评测结果:Zero-shot 泛化之王

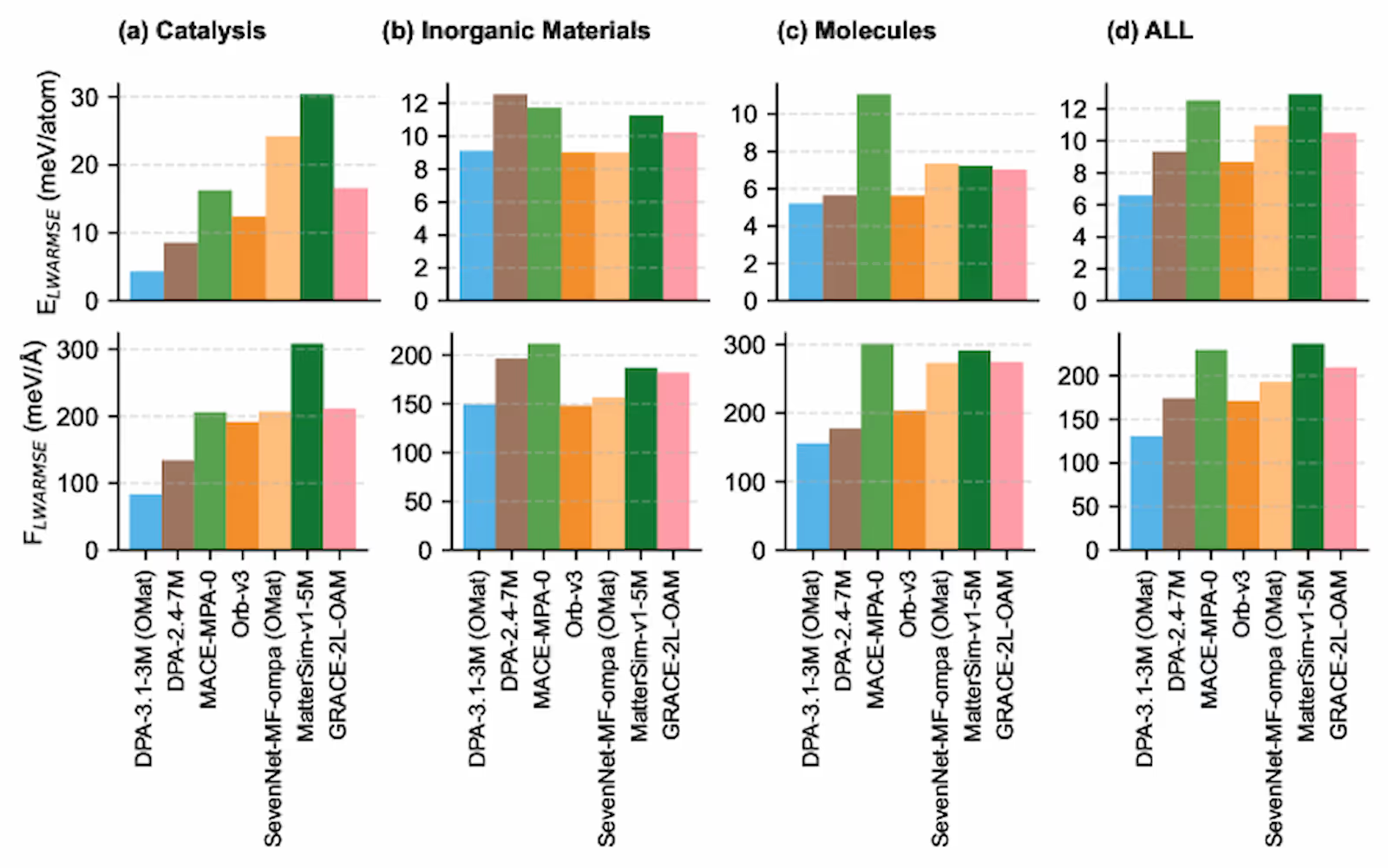

作者使用包含 31 个数据集、涵盖材料、分子、催化等领域的 OpenLAM-v1 数据集,训练了一个拥有 326 万参数的 DPA-3.1-3M 大模型。

在 LAMBench 基准测试中(包含 17 个模型在训练时从未见过的下游任务),DPA-3.1-3M 展现了惊人的零样本(Zero-shot)预测能力。

图片说明: 条形图展示了各大 LAM 模型(如 MACE-MPA-0, SevenNet, MatterSim, Orb-v3 等)在无机材料、小分子、反应、催化等 5 个领域的综合误差。DPA-3.1-3M-bestXC 取得了最低的全局平均误差(0.20)。

- 全面压制: 无论是在小分子、化学反应,还是在表面催化和无机材料领域,DPA-3.1-3M 都展现出了顶级的水准。

- 参数高效: 相比于拥有 2550 万参数的 Orb-v3 模型,DPA-3.1-3M 仅用了约 1/8 的参数量(3.26M),就实现了更低的平均误差(0.20 vs 0.24)。这得益于多任务训练策略和 LiGS 架构的高效特征提取能力。

此外,在 Matbench Discovery(高通量材料发现基准)上,DPA3-L24 也取得了极高的综合性能得分(CPS),在稳定晶体预测方面表现卓越。

6. 总结与启发

DPA3 的提出,标志着 AI for Science 领域的机器学习力场正式迈入了“大模型时代”。

- 对领域新人的启发: 以前我们做分子动力学,需要针对水、铜、蛋白质分别找不同的力场。现在,像 DPA3 这样的 LAM(大原子模型)就像是一个“全科医生”,你把任何原子结构扔给它,它都能直接给出接近量子力学精度的能量和力。

- 对算法专家的启发:

- LiGS 的优雅: 相比于复杂的等变张量积(如 e3nn),线图序列(LiGS)提供了一种纯图论的、标量化的方式来处理高阶几何信息,这在工程实现上更加高效,且更容易扩展层数。

- Dataset Encoding 的潜力: 在多源异构数据融合时,将数据集的先验知识(如泛函类型)作为条件输入(Conditional Input),比多头读出(Multi-head Readout)更节省参数,且能促使底层网络学习到更通用的物理表示。

- 未来展望: 论文证明了 DPA3 完美契合 Scaling Law。这意味着,未来的工作只需要“大力出奇迹”——收集更多的数据(如包含 1 亿构型的 OMol25),使用更多的 GPU,就能训练出通用性更强、精度更高的终极原子模型。

一句话总结: DPA3 通过创新的线图序列架构和数据集编码机制,成功解锁了原子模型的 Scaling Law,为构建统一整个微观物理世界的“基础大模型”铺平了道路。