文献深度解读:当机器学习遇见第一性原理——将分子动力学推向一亿原子极限

文献信息:

标题: Pushing the limit of molecular dynamics with ab initio accuracy to 100 million atoms with machine learning 作者: Weile Jia, Han Wang, Mohan Chen, Denghui Lu, Lin Lin, Roberto Car, Weinan E, Linfeng Zhang 发表会议: SC20 (2020 ACM/IEEE Supercomputing Conference) 荣誉: 2020年 ACM 戈登·贝尔奖 (Gordon Bell Prize) 获奖论文

1. 引言:鱼与熊掌不可兼得的分子动力学困境

在材料科学、化学和生物学中,分子动力学(Molecular Dynamics, MD) 是一种极其重要的计算机模拟方法,它就像是微观世界的“摄像机”,能够记录原子和分子的运动轨迹。

然而,传统的MD模拟一直面临着一个“鱼与熊掌不可兼得”的困境:

- 第一性原理分子动力学(AIMD): 基于量子力学(如密度泛函理论 DFT),计算极其精确,能真实反映化学键的断裂与生成。但它的计算复杂度通常随原子数的立方(\(\mathcal{O}(N^3)\))增长。即使在超级计算机上,也只能模拟几千个原子,时间跨度仅为 皮秒(\(10^{-12}\)秒) 级别。

- 经验力场(EFF): 速度极快,可以模拟数百万原子。但它是基于经验公式拟合的,缺乏泛化能力和精度,难以准确描述复杂的化学反应或多元素系统。

这篇论文的突破在于: 借助深度学习(Deep Learning),作者团队成功打破了这一僵局,在保留 AIMD 级别精度的同时,将计算效率提升到了 EFF 的水平,在 Summit 超级计算机上实现了上亿原子、纳秒级别的模拟,一举斩获超算领域的诺贝尔奖——戈登·贝尔奖。

2. 核心算法:深度势能分子动力学(Deep Potential, DP)

为了让非专家也能理解,我们可以这样比喻:AIMD 是一位极其严谨的物理学家,每算一步都要从头解量子力学方程,所以慢;而 DP 模型则是一个聪明的“AI学徒”,它通过观察物理学家(AIMD)的计算结果,学会了直接从“原子的空间排布”预测“原子受力与能量”的映射关系。

在 DP 方法中,系统的总能量 \(E\) 被假设为所有单个原子局部能量贡献 \(E_i\) 的总和:

$$ E = \sum_i E_i $$

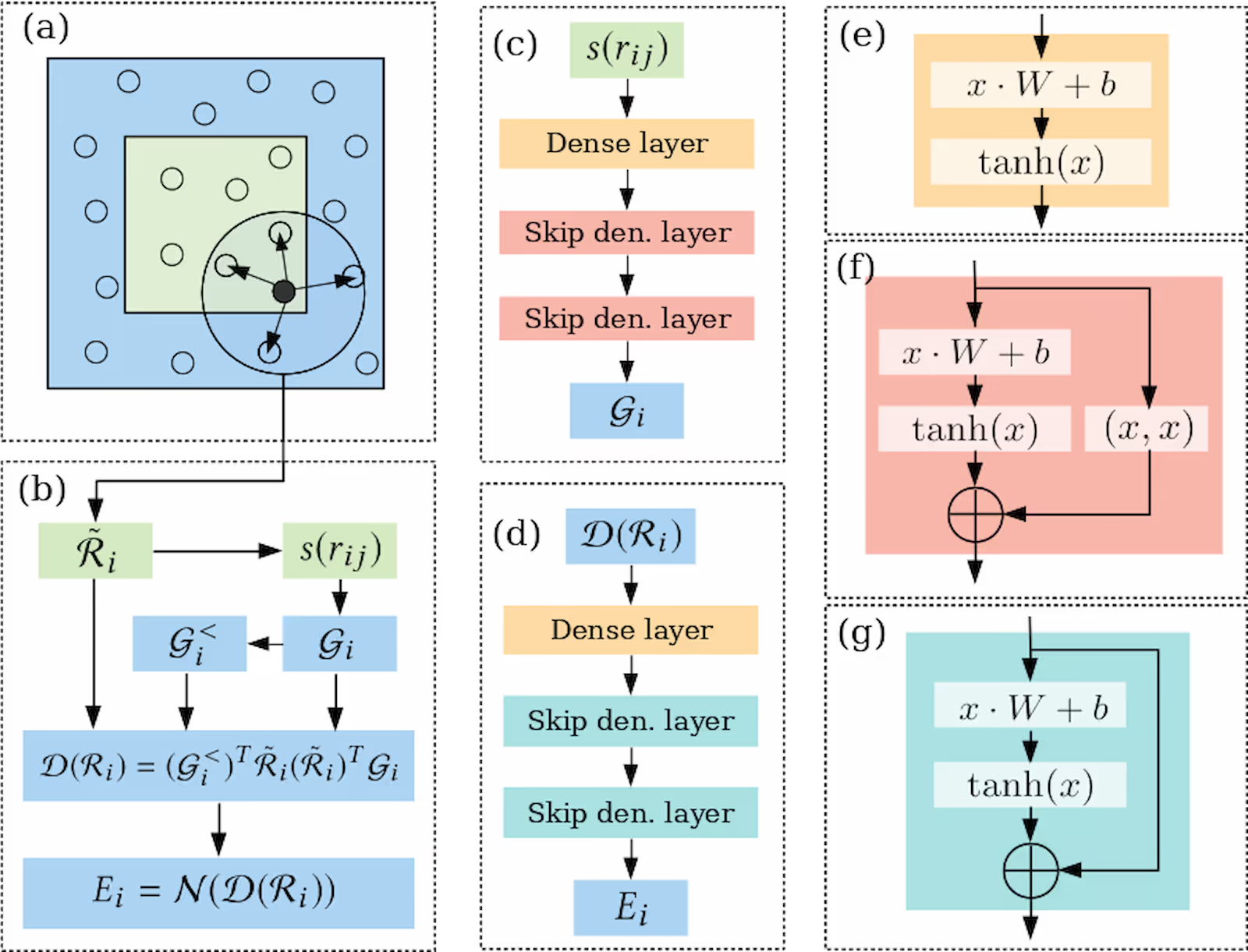

图片说明: 该图直观展示了 DP 方法的架构:(a) MPI任务划分;(b) 单个原子局部环境映射为能量贡献;(c) 嵌入网络(Embedding net)结构;(d) 拟合网络(Fitting net)结构。

DP 模型的工作流(对MLP专家的硬核解析):

- 描述符构建(Descriptors \(\mathcal{D}\)): 将中心原子 \(i\) 及其邻居原子的坐标,转化为平移、旋转和置换不变的矩阵。这里包含一个记录相对位置的环境矩阵 \(\tilde{\mathcal{R}}\) 和一个由深度神经网络(嵌入网络 Embedding Net)生成的嵌入矩阵 \(\mathcal{G}\)。

- 能量拟合(Fitting Net): 描述符 \(\mathcal{D}\) 被输入到一个全连接的前馈神经网络 \(\mathcal{N}\)(拟合网络)中,输出该原子的局部能量 \(E_i\): $$ E_i = \mathcal{N}(\mathcal{D}(\mathcal{R}_i)) $$

- 总能量与力: 系统的总能量是所有 \(E_i\) 的总和,而原子受力则是能量对坐标的导数(通过深度学习框架的反向传播自动求导获得)。

虽然 DP 模型在理论上很完美,但原生的 TensorFlow 实现(DeePMD-kit)在超级计算机上效率极低。因为它的计算图中有大量的小矩阵运算,导致 GPU 的内存带宽和延迟成为巨大瓶颈。

3. 极致的工程优化:如何榨干超级计算机的性能?

这篇论文最精彩的部分,在于作者如何从算法和底层硬件层面,对机器学习框架进行大刀阔斧的改造。对于从事机器学习系统(ML Sys)和多层感知机(MLP)优化的专家来说,以下三点优化极具启发性:

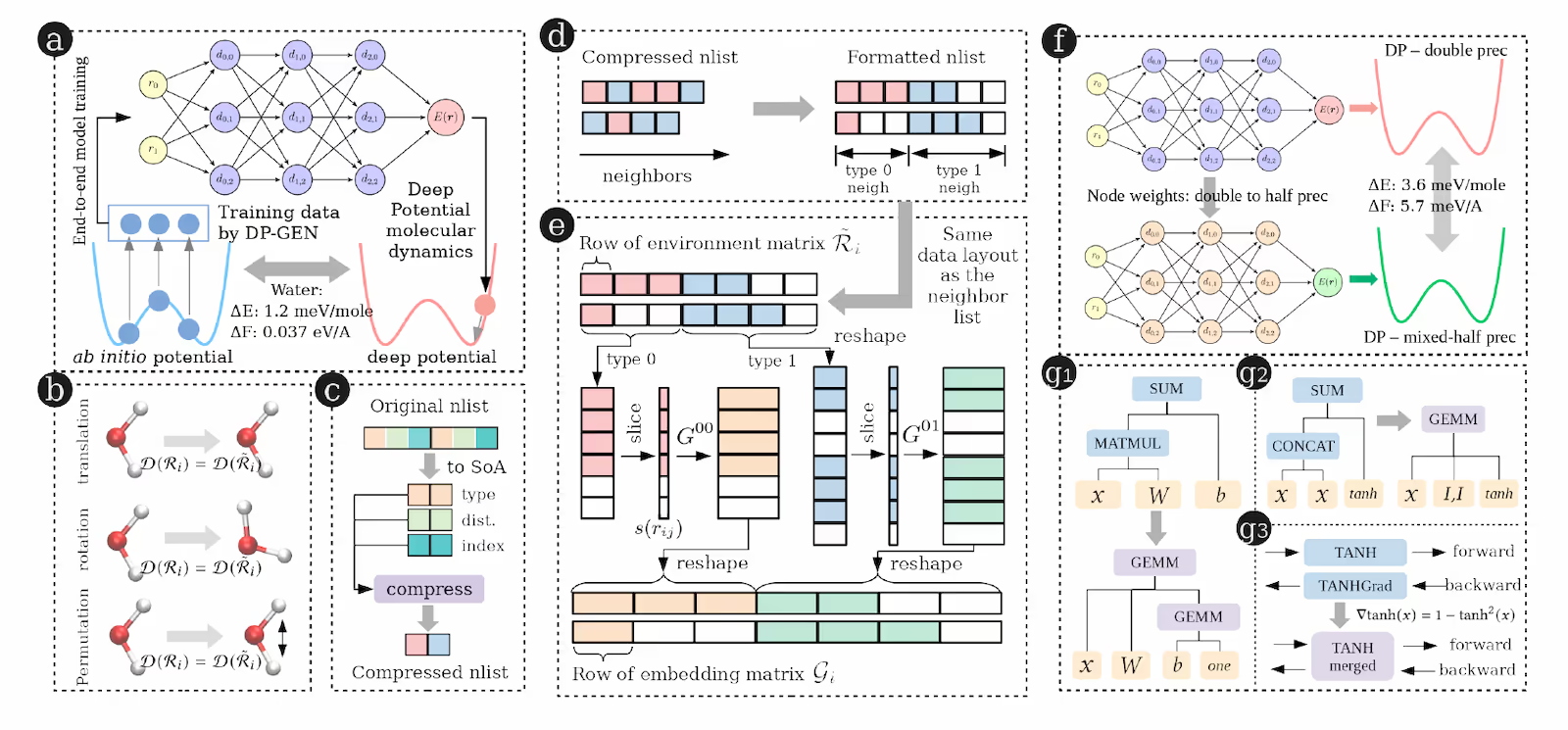

图片说明: 该图详细展示了代码层面的优化,包括:(c) 邻居列表的64位整数压缩;(d) 格式化邻居列表以避免分支;(g) 替换和融合 TensorFlow 算子(如 GEMM 替换 MATMUL+SUM)。

优化一:提高计算粒度与邻居列表压缩(数据布局重构)

在原版中,由于不同原子的邻居数量和类型不同,计算时会产生大量的条件分支(Branching),这在 GPU 上是致命的。

- 消除分支: 作者对邻居列表进行了重新排序(先按原子类型排,再按距离排),并对同类型邻居进行 Padding(填充)对齐。这样就消除了嵌入矩阵计算中的条件分支,大幅提高了计算粒度。

- 64位整数压缩: 传统的 AoS(结构体数组)在 GPU 上会导致内存合并访问失败。作者极其巧妙地将邻居的三个信息(原子类型 \(\alpha(j)\)、距离 \(|r_{ij}|\)、索引 \(j\))压缩进一个 64位无符号整数 中。其数学转换公式如下: $$ \text{Compressed\_Value} = \alpha(j) \times 10^{16} + \lfloor |r_{ij}| \times 10^8 \rfloor \times 10^6 + j $$ 这 20 位十进制数字被完美划分为:4位存类型,10位存距离,6位存索引。这使得排序和内存访问效率在 GPU 上直接飙升。

优化二:定制与融合 TensorFlow 算子(计算图优化)

原版模型中有大量“瘦长”矩阵(Tall and skinny matrices)的乘法和加法,标准 TF 算子对此处理效率极低。

- 算子替换: 将

MATMUL和SUM(偏置相加)合并为底层的单个CUBLAS GEMM调用。 - 算子融合(Kernel Fusion): 激活函数 \(\tanh(x)\) 和其反向传播求导 \(\text{TANHGrad}\) 在每一步 MD 中都要用到。作者注意到其导数存在解析关系: $$ \nabla \tanh(x) = 1 - \tanh^2(x) $$ 于是作者写了一个定制的 CUDA Kernel,将这两个操作融合,用空间换时间,大幅减少了显存读写延迟。

优化三:混合精度计算(Mixed-Precision)

并非所有计算都需要双精度(FP64)。作者提出了 MIX-32 和 MIX-16 两种混合精度策略:

- 坐标与环境矩阵: 保持 FP64,确保物理位置的绝对精确。

- 神经网络参数与运算: 在 MIX-32 中使用单精度(FP32);在 MIX-16 中,嵌入网络和前两层拟合网络使用半精度(FP16),并充分利用 NVIDIA V100 的 Tensor Cores。

- 结果: 混合精度不仅将显存占用减半甚至降至25%,速度提升了数倍,而且通过径向分布函数(RDF)验证,物理精度几乎没有损失!

4. 惊艳的性能表现:Summit 超算上的巅峰对决

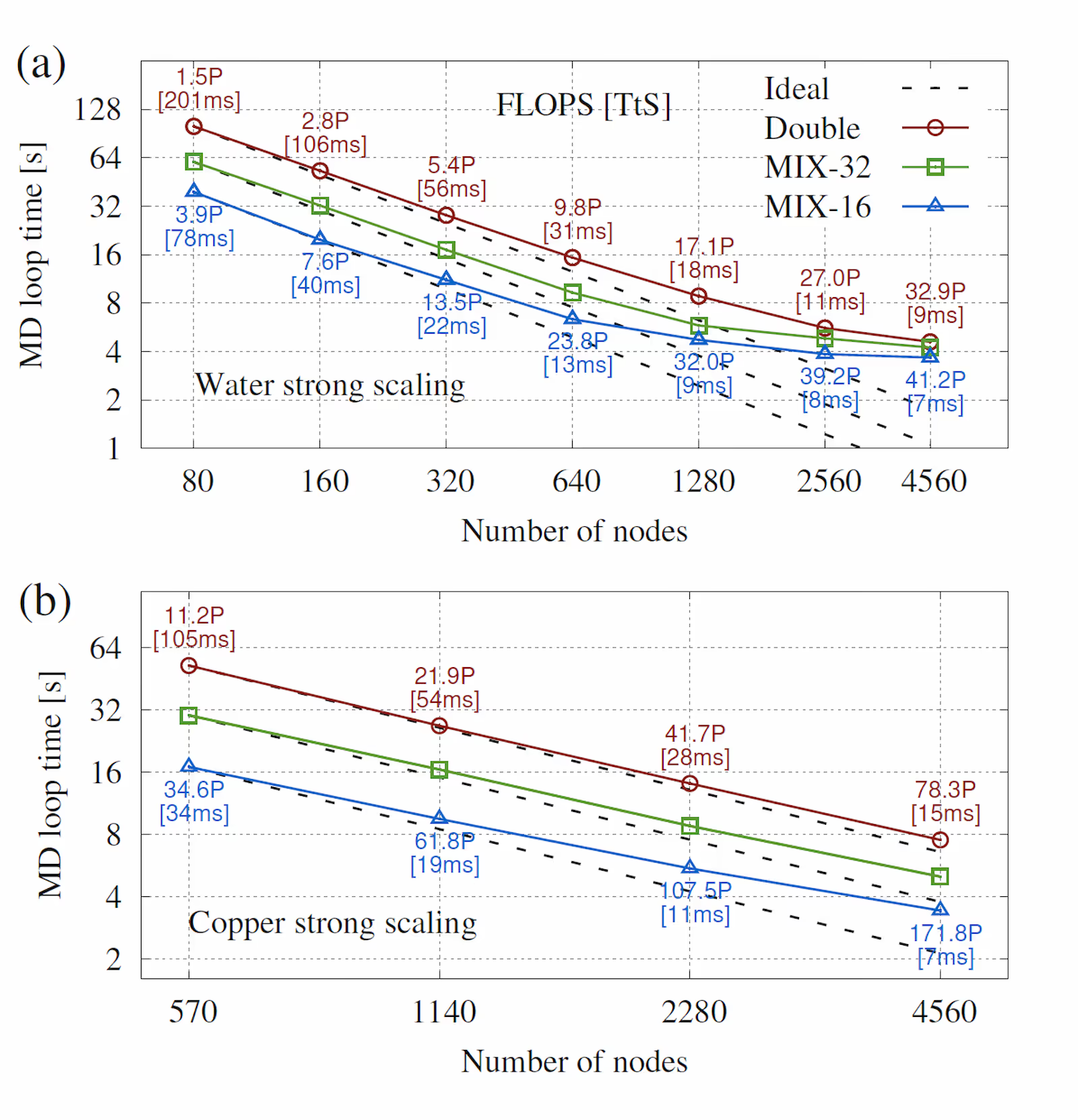

作者在美国橡树岭国家实验室的 Summit 超级计算机(当时世界排名第二)上进行了测试,动用了 4,560 个节点(共 27,360 块 V100 GPU)。

图片说明: 图表展示了在不同节点数量下,系统计算 500 步 MD 所需的时间和达到的 PFLOPS,体现了近乎完美的线性扩展能力。

- 极致规模: 成功模拟了 1.27亿原子的铜系统 和 6.79亿原子的水系统。

- 算力巅峰: 在 MIX-16 精度下,铜系统达到了惊人的 275 PFLOPS(每秒27.5亿亿次浮点运算)。

- 时间达标: 1.27亿原子的铜系统,每步耗时仅 2.7 毫秒。这意味着,每天可以完成 2.5 纳秒的模拟。在保持量子力学精度的前提下,这个速度比此前的最先进水平提高了 1000倍以上!

5. 科学应用:纳米晶铜的拉伸变形

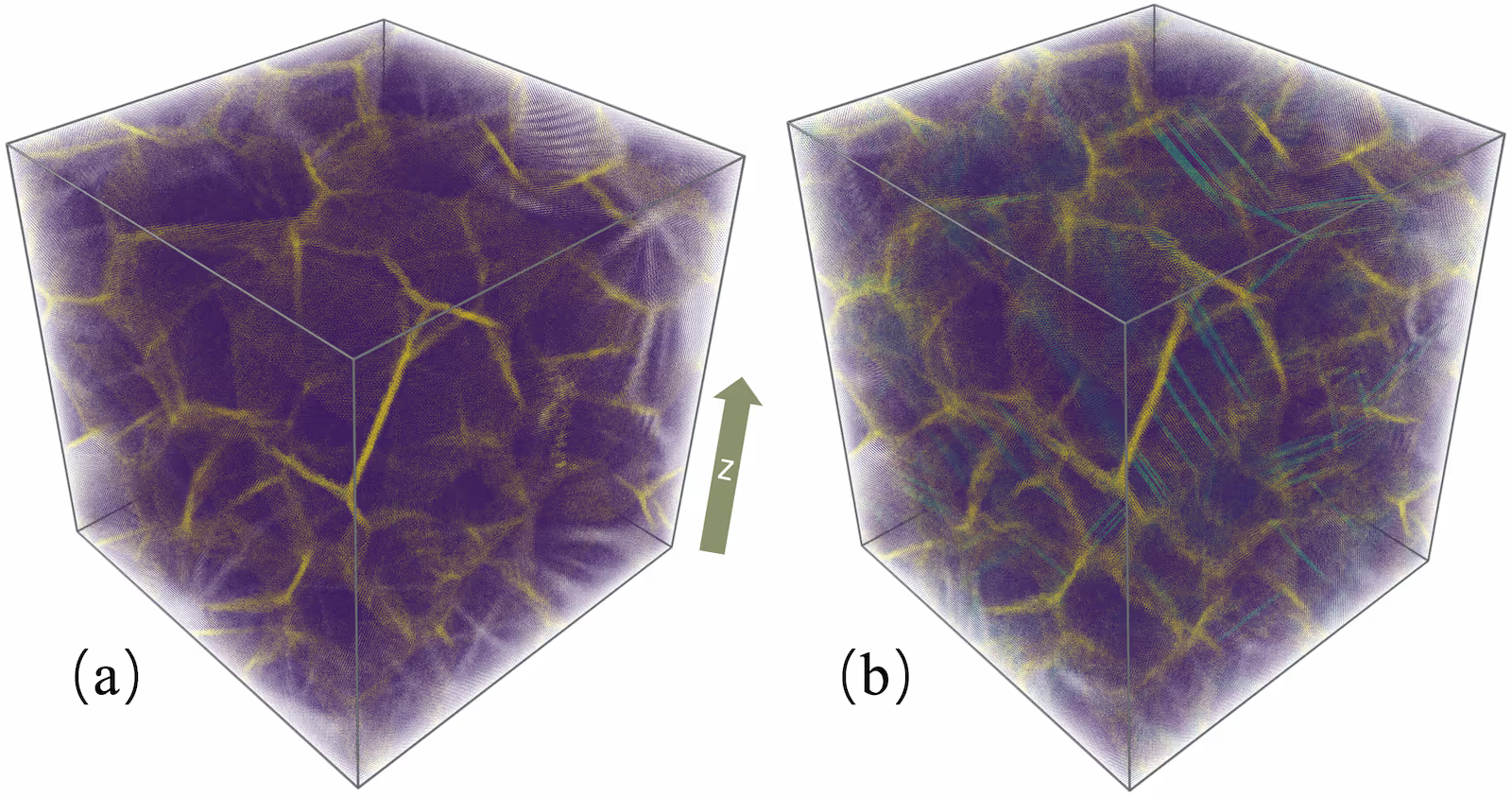

为了证明这不仅仅是一个“跑分”软件,作者实际应用该模型模拟了包含 1040万原子的纳米晶铜的拉伸变形过程。

图片说明: 左图(a)为初始状态,包含64个随机取向的晶粒;右图(b)为沿z轴拉伸10%后的状态,紫色、黄色和青色分别代表晶粒内原子、晶界原子和层错原子。

传统的经验力场(EFF)很难准确预测铜的表面形成能和层错能,而 DP 模型完美克服了这一点。通过模拟,研究人员可以清晰地追踪到晶界运动、位错产生以及六方最密堆积(hcp)层错的形成。这为研究轻质高强合金的微观力学机制打开了全新的大门。

6. 总结与启发

这篇论文是 AI for Science (AI4S) 领域的一座里程碑。它带给我们的核心启发包括:

- 对领域新人的启发: 机器学习不仅仅是用来做图像识别或自然语言处理的。通过将物理定律(对称性、守恒律)融入神经网络架构,AI 可以成为连接微观量子力学与宏观材料性质的终极桥梁。

- 对 MLP/系统专家的启发: 算法的理论上限往往被底层硬件的实现所束缚。在面对具有特定物理意义的神经网络时(如大量小矩阵、特殊的内存访问模式),通用的深度学习框架(如原生的 TensorFlow/PyTorch)往往效率低下。深入理解数据流,进行定制化的内存布局重构(如64位整数压缩)、算子融合以及针对 Tensor Core 的混合精度设计,是释放算力的关键。

- 未来展望: 随着下一代百亿亿次(Exascale)超级计算机的到来,基于深度学习的分子动力学有望彻底改变药物设计、电池材料研发、复杂化学反应分析等诸多关乎人类未来的核心科技领域。

这不仅是一次算力的胜利,更是物理学、应用数学与计算机科学跨界融合的完美典范。